안녕하세요! 오늘은 AI 기술의 가장 큰 난제로 꼽히는 '환각(Hallucination)' 현상에 대해 조금 더 깊이 있는 이야기를 나눠보려 합니다.

많은 분들이 AI가 엉뚱한 거짓말을 하는 환각 현상을 단순히 '고쳐야 할 기술적 결함'으로 생각합니다. 하지만 최근 연구와 업계의 시각은 이것이 단순 오류가 아닌, 구조적인 필연일 수 있음을 시사하고 있습니다.

1. 기술적 결함이 아닌, '수학적 한계'

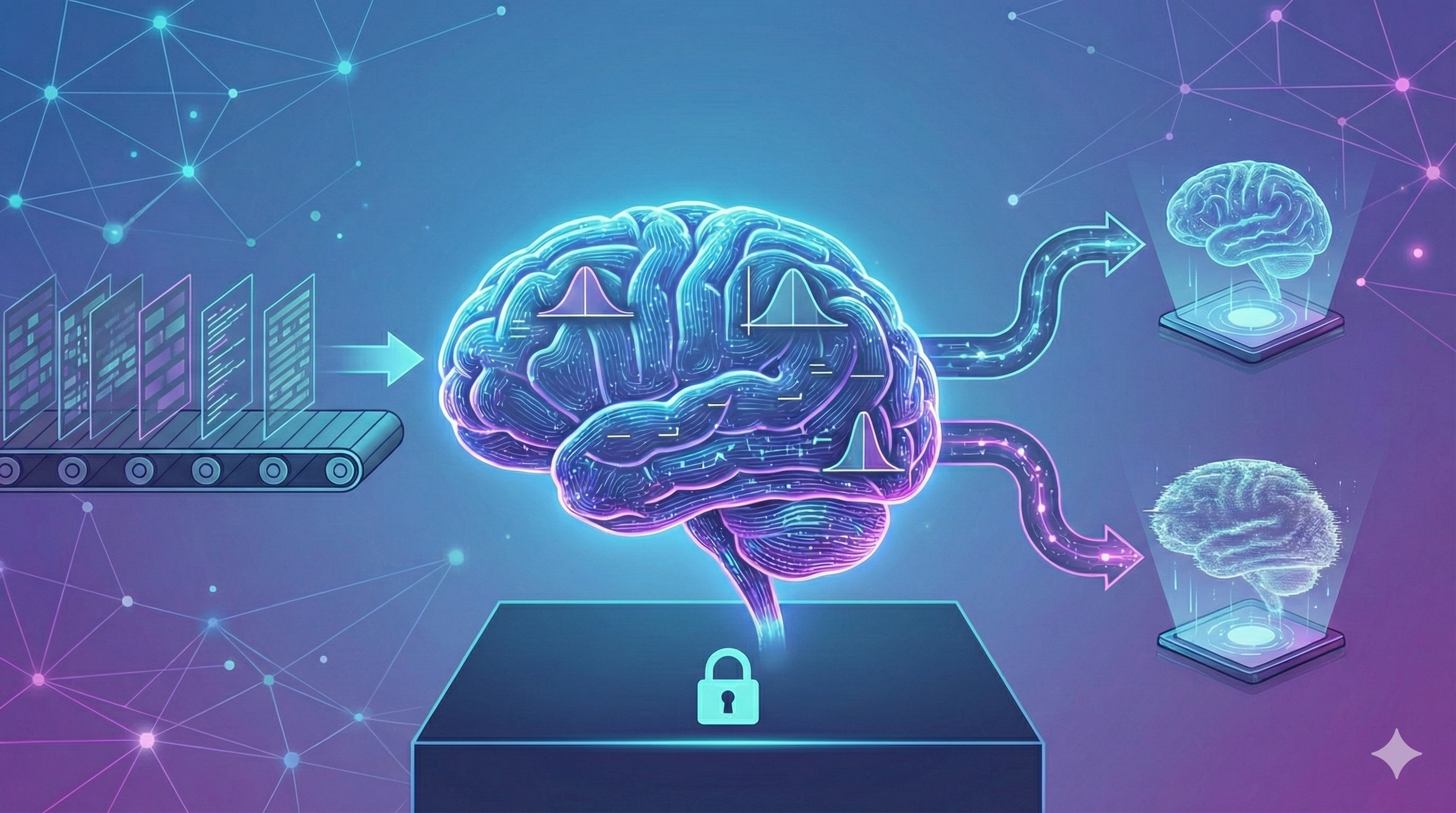

오픈AI 연구진을 포함한 전문가들의 분석에 따르면, AI 환각은 데이터나 설계의 문제가 아닌 '불가피한 수학적 한계'에서 비롯됩니다.

• 구조적 필연성: 거대언어모델(LLM)은 정답이 불확실할 때 통계적으로 가장 그럴듯한 답을 '추측'하도록 설계되어 있습니다.

• 고급 모델의 역설: 아이러니하게도 최신·고급 모델일수록 더 그럴듯하게 답을 만들어내기에 환각의 빈도가 여전히 높게 나타납니다.

즉, 환각은 제거해야 할 버그가 아니라, 생성형 AI의 작동 원리상 발생할 수밖에 없는 특성이라는 것입니다.

2. 환각을 부추기는 산업계의 평가 방식

더 큰 문제는 현재 산업계의 AI 모델 평가 방식이 이 문제를 심화시키고 있다는 점입니다.

현재의 주요 평가 지표들은 AI가 '모른다'고 대답하는 불확실성보다는, 틀리더라도 자신감 있게 대답하는 것에 점수를 더 주는 경향이 있습니다.

• 오답에 대한 보상: 현행 평가 구조는 오답을 추측해서라도 내놓는 행위에 보상을 제공하여, 결과적으로 환각을 키우는 요인이 되고 있습니다.

• 규제 산업의 위험: 특히 정확성이 생명인 규제 산업 분야에서는 이러한 환각 문제가 더욱 심각한 리스크가 될 수 있습니다.

3. 이제는 '예방'이 아닌 '관리'로

AI 환각이 영구적인 현실이라면, 기업의 전략도 수정되어야 합니다. 완벽한 예방보다는 체계적인 '위험 관리' 중심으로의 전환이 필요합니다.

• 기업의 과제: 거버넌스와 위험 관리 체계를 구축하고, 무엇보다 신뢰도와 투명성을 우선순위에 두어야 합니다.

• 제도적 개선: 국가 차원에서도 모델의 신뢰도를 지속적으로 모니터링할 수 있는 '동적 등급제' 도입 등 평가 체계의 개편이 논의되어야 합니다.

AI 환각은 영구적인 현실입니다. 이제는 이를 인정하고 전략의 변화가 필수적인 시점입니다.

AI는 강력한 도구이지만 그 한계를 명확히 인지하고 사용할 때 진정한 가치를 발휘합니다. 환각 현상을 단순한 기술적 실패로 볼 것이 아니라, 이를 관리하고 통제할 수 있는 새로운 거버넌스를 고민해야 합니다.